เมื่อวันอังคารที่ผ่านมา meta ได้ประกาศโมเดลปัญญาประดิษฐ์ Llama เวอร์ชันล่าสุดซึ่งมีชื่อว่า Llama 3.1 เทคโนโลยี Llama ใหม่ล่าสุดมีสามเวอร์ชันที่แตกต่างกัน โดยเวอร์ชันหนึ่งเป็นโมเดล AI ที่ใหญ่ที่สุดและมีความสามารถมากที่สุดจาก Meta จนถึงปัจจุบัน รุ่นใหม่ล่าสุดยังคงเป็นโอเพ่นซอร์ส ซึ่งหมายความว่าสามารถเข้าถึงได้ฟรี

Large language model หรือ LLM เน้นย้ำถึงการลงทุนมหาศาลของเครือข่ายโซเชียลในการติดตามการใช้จ่ายด้าน AI ร่วมกับสตาร์ทอัพระดับสูงอย่าง OpenAI และ Anthropic และยักษ์ใหญ่ด้านเทคโนโลยีอื่น ๆ เช่น Google และ Amazon

การประกาศดังกล่าวยังเน้นย้ำถึงความร่วมมือที่เพิ่มขึ้นระหว่าง Meta และ Nvidia

Nvidia เป็นพันธมิตร Meta ที่สำคัญ โดยจัดหาชิปประมวลผลที่เรียกว่า GPU ให้กับผู้ปกครองของ Facebook เพื่อช่วยฝึกฝนโมเดล AI รวมถึง Llama เวอร์ชันล่าสุด

ในขณะที่บริษัทอย่าง OpenAI ตั้งเป้าที่จะสร้างรายได้จากการขายการเข้าถึง LLM ที่เป็นกรรมสิทธิ์ของตน หรือเสนอบริการเพื่อช่วยให้ลูกค้าใช้เทคโนโลยีดังกล่าว แต่ Meta ไม่มีแผนที่จะเปิดตัวธุรกิจองค์กรที่เป็นคู่แข่งของตัวเอง โฆษกของ Meta กล่าวระหว่างการบรรยายสรุปกับสื่อ

คล้ายกับเมื่อ Meta เปิดตัว Llama 2 เมื่อฤดูร้อนปีที่แล้ว บริษัทกำลังร่วมมือกับบริษัทเทคโนโลยีจำนวนหนึ่งที่จะให้ลูกค้าสามารถเข้าถึง Llama 3.1 ผ่านทางแพลตฟอร์มคอมพิวเตอร์คลาวด์ของตน ตลอดจนขายระบบ securitty และการจัดการที่ทำงานร่วมกับ ซอฟต์แวร์ใหม่ พันธมิตรองค์กรที่เกี่ยวข้องกับ Llama 25 ราย ได้แก่ Amazon Web Services, Google Cloud, Microsoft Azure, Databricks และ Dell

แม้ว่า Mark Zuckerberg ซีอีโอของ Meta ได้บอกกับนักวิเคราะห์ในระหว่างการโทรหารายได้ของบริษัทว่าบริษัทสร้างรายได้บางส่วนจากความร่วมมือของบริษัท Llama แต่โฆษกของ Meta กล่าวว่าผลประโยชน์ทางการเงินใดๆ ก็ตามนั้นเป็นเพียงการเพิ่มขึ้นเท่านั้น แต่ Meta เชื่อว่าการลงทุนครั้งก่อนใน Llama และเทคโนโลยี AI ที่เกี่ยวข้อง และเปิดให้ใช้งานได้ฟรีผ่านโอเพ่นซอร์ส โดยสามารถดึงดูดผู้มีความสามารถคุณภาพสูงในตลาดที่มีการแข่งขันสูง และลดต้นทุนโครงสร้างพื้นฐานการประมวลผลโดยรวม ตลอดจนสิทธิประโยชน์อื่นๆ

การเปิดตัว Llama 3.1 ของ Meta เกิดขึ้นก่อนการประชุมเกี่ยวกับคอมพิวเตอร์กราฟิกขั้นสูงซึ่ง Zuckerberg และ Jensen Huang ซีอีโอของ Nvidia มีกำหนดจะพูดคุยร่วมกัน

ยักษ์ใหญ่เครือข่ายโซเชียลเป็นหนึ่งในลูกค้าระดับบนของ Nvidia ที่ไม่ได้ใช้งานคลาวด์สำหรับธุรกิจของตัวเอง และ Meta ต้องการชิปล่าสุดเพื่อฝึกโมเดล AI ซึ่งใช้ภายในสำหรับการกำหนดเป้าหมายและผลิตภัณฑ์อื่น ๆ Meta กล่าวว่ารุ่นที่ใหญ่ที่สุดของรุ่น Llama 3.1 ที่ประกาศเมื่อวันอังคารได้รับการฝึกฝนกับโปรเซสเซอร์กราฟิก H100 ของ Nvidia จำนวน 16,000 ตัว

แต่ความสัมพันธ์ก็มีความสำคัญต่อทั้งสองบริษัทด้วยในสิ่งที่เป็นตัวแทน

สำหรับ Nvidia ความจริงที่ว่า Meta กำลังฝึกอบรมโมเดลโอเพ่นซอร์สที่บริษัทอื่นสามารถใช้และปรับใช้สำหรับธุรกิจของตน โดยไม่ต้องจ่ายค่าธรรมเนียมใบอนุญาตหรือขออนุญาต สามารถขยายการใช้งานชิปของ Nvidia เองและรักษาความต้องการให้อยู่ในระดับสูง

แต่โมเดลโอเพ่นซอร์สอาจมีราคาหลายร้อยล้านหรือหลายพันล้านดอลลาร์ในการสร้าง โมเดลส่วนตัวที่ทันสมัยที่สุด

ในทางกลับกัน Meta ต้องการการจัดหา GPU ล่าสุดที่เชื่อถือได้เพื่อฝึกฝนโมเดลที่ทรงพลังมากขึ้น เช่นเดียวกับ Nvidia Meta กำลังพยายามส่งเสริมระบบนิเวศของนักพัฒนาที่กำลังสร้างแอป AI ด้วยซอฟต์แวร์โอเพ่นซอร์สของบริษัทที่เป็นศูนย์กลาง แม้ว่า Meta ต้องแจกโค้ดและสิ่งที่เรียกว่าน้ำหนัก AI ซึ่งมีราคาแพงในการสร้าง

แนวทางโอเพ่นซอร์สมีประโยชน์ต่อ Meta โดยการเปิดเผยให้นักพัฒนาทราบถึงเครื่องมือภายในของตน และโดยการเชิญชวนให้พวกเขาสร้างมันขึ้นมา Ash Jhaveri รองประธานฝ่ายความร่วมมือ AI ของบริษัท กล่าวกับ CNBC นอกจากนี้ยังช่วย Meta อีกด้วย เนื่องจากใช้โมเดล AI ภายใน ช่วยให้บริษัทได้รับการปรับปรุงจากชุมชนโอเพ่นซอร์ส เขากล่าว

Zuckerberg เขียนในบล็อกโพสต์เมื่อวันอังคารว่ากำลังใช้ “แนวทางที่แตกต่าง” กับการเปิดตัว Llama ในสัปดาห์นี้ โดยเสริมว่า “เรากำลังสร้างความร่วมมืออย่างแข็งขันเพื่อให้บริษัทต่างๆ ในระบบนิเวศสามารถนำเสนอฟังก์ชันการทำงานที่เป็นเอกลักษณ์ให้กับลูกค้าของพวกเขาได้เช่นกัน ”

เนื่องจาก Meta ไม่ใช่ผู้จำหน่ายระดับองค์กร จึงส่งต่อบริษัทที่สอบถามเกี่ยวกับ Llama ไปยังหนึ่งในพันธมิตรระดับองค์กร เช่น Nvidia ได้ Jhaveri กล่าว

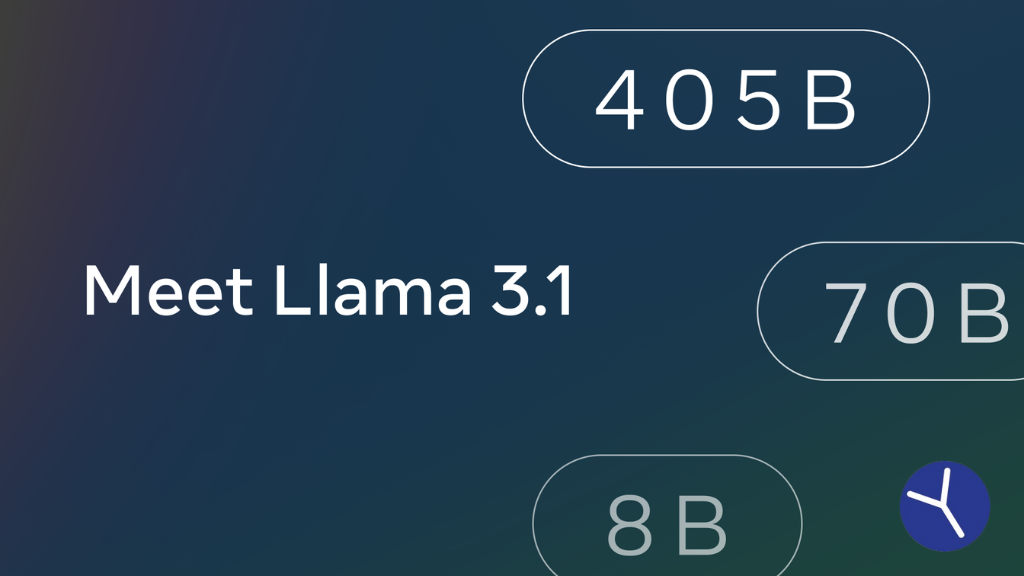

เวอร์ชันที่ใหญ่ที่สุดของตระกูล Llama 3.1 เรียกว่า Llama 3.1 405B LLM นี้มีพารามิเตอร์ 405 พันล้าน ซึ่งหมายถึงตัวแปรที่กำหนดขนาดโดยรวมของโมเดลและปริมาณข้อมูลที่สามารถประมวลผลได้

โดยทั่วไป LLM ขนาดใหญ่ที่มีพารามิเตอร์จำนวนมากสามารถทำงานที่ซับซ้อนได้มากกว่า LLM ขนาดเล็ก เช่น การทำความเข้าใจบริบทในข้อความยาวๆ แก้สมการทางคณิตศาสตร์ที่ซับซ้อน และแม้กระทั่งสร้างข้อมูลสังเคราะห์ที่สามารถนำมาใช้เพื่อปรับปรุงโมเดล AI ที่เล็กลงได้ .

Meta ยังเปิดตัว Llama 3.1 เวอร์ชันเล็กที่เรียกว่า Llama 3.1 8B และ Llama 3.1 70B โดยพื้นฐานแล้วเป็นเวอร์ชันอัปเกรดของรุ่นก่อนและสามารถใช้เพื่อขับเคลื่อนแชทบอทและผู้ช่วยเขียนโค้ดซอฟต์แวร์ได้

Meta ยังกล่าวอีกว่าผู้ใช้ WhatsApp ในสหรัฐอเมริกาและผู้เยี่ยมชมเว็บไซต์ Meta.AI จะสามารถเห็นความสามารถของ Llama 3.1 ได้โดยการโต้ตอบกับผู้ช่วยดิจิทัลของบริษัท ซึ่งจะทำงานบน Llama เวอร์ชันล่าสุด โฆษกของ Meta อธิบายจะสามารถตอบปัญหาทางคณิตศาสตร์ที่ซับซ้อนหรือแก้ปัญหาการเข้ารหัสซอฟต์แวร์ได้

ผู้ใช้ WhatsApp และ Meta.AI ที่อยู่ในสหรัฐอเมริกาจะสามารถสลับระหว่าง Llama 3.1 LLM ขนาดยักษ์ใหม่หรือเวอร์ชันที่มีความสามารถน้อยกว่า แต่เร็วกว่าและเล็กกว่าเพื่อหาคำตอบสำหรับคำถามของพวกเขา โฆษกของ Meta กล่าว

ข้อมูลจาก : CNBC